当 AI 让我们越来越像:LLM 正在悄悄同质化人类思维

USC 的一项新研究给 AI 从业者敲了个警钟:LLM 不只是在帮我们写作,它正在悄悄重塑我们思考问题的方式 —— 而且是朝着同一个方向。 研究发现:我们正在变得越来越像 南加州大学的计算机科学家和心理学家在 3 月 11 日发表于 Trends in Cognitive Sciences 的论文中指出,当数十亿人使用同一批 AI 聊天机器人完成日益增多的任务时,人类的认知多样性正在萎缩...

USC 的一项新研究给 AI 从业者敲了个警钟:LLM 不只是在帮我们写作,它正在悄悄重塑我们思考问题的方式 —— 而且是朝着同一个方向。 研究发现:我们正在变得越来越像 南加州大学的计算机科学家和心理学家在 3 月 11 日发表于 Trends in Cognitive Sciences 的论文中指出,当数十亿人使用同一批 AI 聊天机器人完成日益增多的任务时,人类的认知多样性正在萎缩...

昨天 HN 首页有个 Show HN 冲到 264 分:Parlor — 作者 Fikri 把 Gemma 3n E2B 塞进一台 M3 Pro,跑出了一个实时的音频+视频输入、语音输出的本地多模态 agent。不是云端 API 串起来的 demo,是真正 on-device 的闭环。 我看到这条的时候第一反应是:哦,本地实时多模态从”PPT 概念”正式变成”你现在就能 clone 下来跑...

事件时间: 2026 年 4 月 4 日 12:00 PT 来源: Anthropic 官方公告 / Boris Cherny X 推文 / VentureBeat 报道 解读: Cobb @ OfoxAI Lab 一句话版本:从 4 月 4 日起,你不能再用 Claude Pro/Max 订阅去喂 OpenClaw 这类第三方 Agent 工具了。 想继续用?要么切到 API 按 ...

昨天 HN 上一篇文章冲到了 920 分:Eight years of wanting, three months of building with AI。作者 Lalit Maganti 花了八年时间「想做」一套 SQLite 开发工具,结果在 AI 编码工具的辅助下,三个月就做出来了。 这篇文章值得一读的地方在于,它不是那种「AI 帮我一键生成」的吹牛帖,也不是「AI 全是垃圾」的反智...

Karpathy 昨天在 GitHub Gist 上扔了一份”idea file”——LLM Wiki,HN 顶到 275 分。文件本身只有几百字,但它戳到了我最近一直在想的事:RAG 这条路,可能从一开始就走偏了。 RAG 的根本问题:每次都从零开始 主流 RAG 的工作方式很统一:把文档切片、embedding、塞进向量库,查询的时候捞回来几段拼到 prompt 里。Notebook...

今天 Hacker News 首页一篇 Show HN 冲到了 429 分:GuppyLM,作者 arman-bd 写了一个”小到可以读完”的 LLM,目的只有一个 —— 让你真正搞懂 GPT 是怎么工作的。我点进去看了一眼,决定写点东西。 一条小鱼,一份完整可读的 Transformer 实现 为什么”小”很重要 过去两年我们都被各种”从零实现 GPT”的教程刷过屏 —— Karp...

昨天 Hacker News 上有一篇文章引起了广泛共鸣 —— Google 工程师 Lalit Maganti 分享了他用 AI coding agent 在三个月内完成了一个想做八年的项目:syntaqlite,一套高质量的 SQLite 开发工具。 这篇文章之所以值得细看,不是因为它在吹 AI 多厉害,恰恰相反 —— 它是我见过的对「AI 辅助开发」最诚实、最系统的复盘之一。 八年...

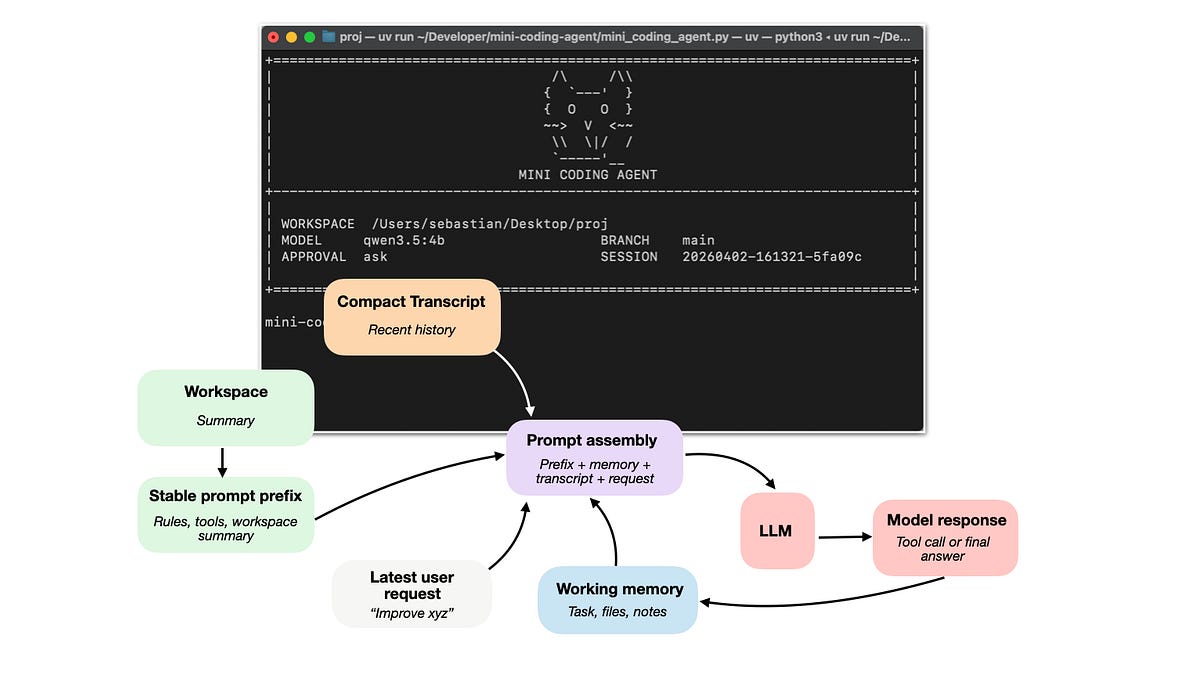

Sebastian Raschka 最近发了一篇长文,系统拆解了 Coding Agent 的架构组成。作为 Build a Large Language Model (From Scratch) 的作者,他这次把视角从模型本身拉到了模型之上的工程系统。核心观点很明确:模型是引擎,但 harness 才决定了你能跑多远。 三个容易混淆的概念 文章开头厘清了一个常见混淆:LLM、推理模型(...

从 macOS Tahoe(macOS 26)开始,每台 Apple Silicon Mac 都内置了一个约 3B 参数的语言模型。Apple 把它锁在 Siri 和 Apple Intelligence 的围墙里,普通开发者碰不到。 一个叫 Apfel 的开源项目把它放了出来。 你的 Mac 里有什么 Apple 通过 FoundationModels 框架在 macOS 26 中集...

作为 OfoxAI(ofox.ai)的开发者,我每天都在跟各种 AI 应用架构打交道。今天在 Hacker News 上看到一篇让我眼前一亮的文章 —— Mintlify 把他们的 AI 文档助手从 RAG 架构切换成了虚拟文件系统,效果惊人。 RAG 的瓶颈在哪 RAG(Retrieval-Augmented Generation)是目前 AI 应用的标配方案:把文档切成 chunk,...