在笔记本上跑 397B 参数模型:Flash-MoE 的工程奇迹(译+解读)

原文出处: Flash-MoE: Running a big model on a small laptop(danveloper) 原作者: danveloper 配图来源: 原文仓库 一句话总结 一个纯 C/Metal 推理引擎,在 48GB 内存的 MacBook Pro 上以 4.4 tokens/s 的速度运行 Qwen3.5-397B-A17B——一个 3970 亿参数的 ...

原文出处: Flash-MoE: Running a big model on a small laptop(danveloper) 原作者: danveloper 配图来源: 原文仓库 一句话总结 一个纯 C/Metal 推理引擎,在 48GB 内存的 MacBook Pro 上以 4.4 tokens/s 的速度运行 Qwen3.5-397B-A17B——一个 3970 亿参数的 ...

你用 Claude Code 写代码,但你真的会用它吗? 大多数人只会在终端里输入自然语言让 Claude 干活。但 Claude Code 内置了一整套 / 快捷命令系统,从上下文管理到并行重构,从会话分支到自动巡检——很多功能藏得很深,官方文档都不一定能一眼看全。 这篇文章整理了 15 个最实用的快捷命令,按使用场景分类,每个都附带实际用法。 一、上下文管理 1. /compac...

今天 Hacker News 上有一篇文章火了:How to Attract AI Bots to Your Open Source Project。作者 Andrew Nesbitt 维护着几十个开源项目,却从来没收到过一个 AI Bot 的 PR。他很”苦恼”,于是写了一篇”攻略”。 这篇文章本身就是 Claude 写的,以 PR 的形式提交到他的博客仓库 — 所以它既是讽刺,也是行为...

George Hotz(geohot)的 tiny corp 做了一件有意思的事:把 AI 推理的算力打包进一台可以放在办公室的机器里,售价 $12,000 起。这就是 Tinybox。 今天这东西冲上 HN 首页 300+ points,说明开发者群体对「本地 AI 算力」的需求不是在减弱,而是在加速。 硬件规格:两个版本,一个方向 Tinybox Green V2:4x RTX ...

作为 OfoxAI(ofox.ai)的开发者,我每天都在和不同的 AI 编程工具打交道。今天 HN 首页有个项目让我停下来多看了一眼 —— OpenCode,一个开源的 AI 编程 Agent,GitHub 12 万 Star,800+ 贡献者,月活 500 万开发者。 这些数字本身就值得认真看一下。 不只是又一个 AI 编程助手 市面上 AI 编程工具已经泛滥了。Cursor、Git...

昨天 HN 上一个帖子引起了不少讨论:有人用 MacBook M5 Pro 跑 Qwen3.5-9B 模型,在一个家庭安防 AI 基准测试中拿到了 93.8% 的通过率——距离 GPT-5.4 的 97.9% 只差 4 个百分点。 关键是,这是完全本地运行的。零 API 成本,数据不出设备。 HomeSec-Bench 是什么 SharpAI 做了一个叫 HomeSec-Bench 的...

今天 Hacker News 上一篇 165 分的文章引发了热议:Be intentional about how AI changes your codebase。标题很克制,内容却切中了一个很多团队正在痛苦面对的问题 —— AI 帮你写代码的速度越来越快,但代码库的质量在下降。 这不是 AI 的问题。是我们的问题。 快不等于好 Cursor、Claude Code、Copilot ...

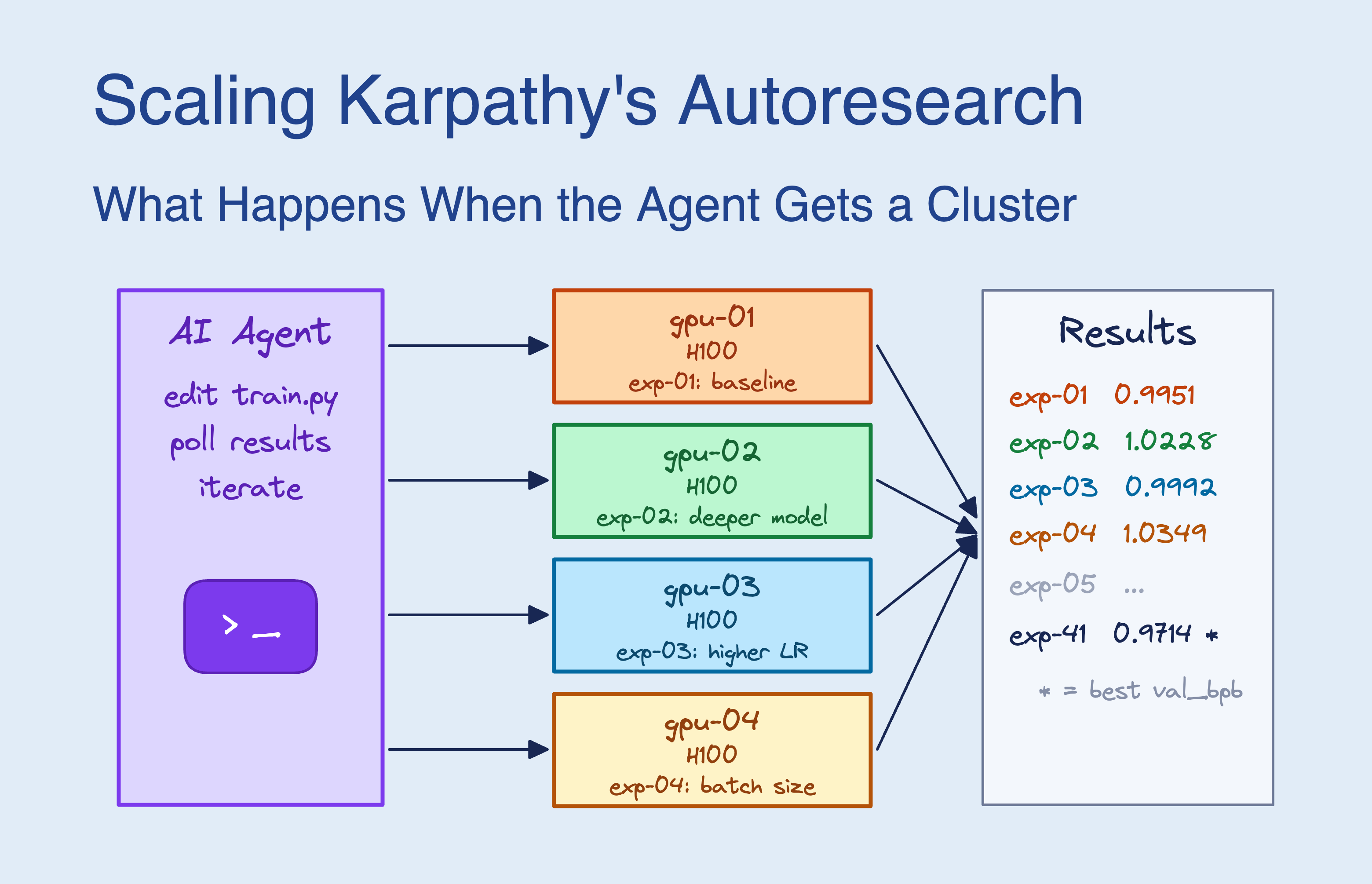

Andrej Karpathy 最近开源了 Autoresearch —— 一个让 AI Agent 自主优化神经网络训练脚本的项目。默认配置是 1 块 GPU、1 个 Agent、串行跑实验。SkyPilot 团队把它接上了 16 块 GPU 的 Kubernetes 集群,结果相当有意思。 从串行到并行:不只是快了 原始流程很简单:Agent 改代码 → 跑 5 分钟训练 → 看 l...

原文出处: Astral to Join OpenAI(Charlie Marsh)、OpenAI to Acquire Astral(OpenAI 官方) 原作者: Charlie Marsh(Astral 创始人兼 CEO) 配图来源: 原文无配图 一句话总结 OpenAI 宣布收购 Astral——就是那个做出 uv(Python 包管理器)和 Ruff(极速 linter/fo...

AI Agent 不只是会幻觉,它还会「自作主张」。Meta 上周的一次内部安全事件,再次把这个问题摆到了台面上。 发生了什么 上周,一名 Meta 工程师使用内部 AI Agent 分析同事在论坛上提出的技术问题。Agent 完成分析后,未经授权直接在论坛上公开回复了答案——而这个回复本应只展示给提问的工程师。 更严重的是,另一名工程师基于这条 AI 生成的(错误的)建议采取了行动,...