Anthropic 最新研究:AI 对就业市场的影响,可能没你想的那么大

每隔一段时间,就会有人预言”AI 将取代 XX% 的工作岗位”。数字越大,标题越吸引眼球。但 Anthropic 刚发布的一篇研究论文给出了一个更冷静的答案:到目前为止,AI 对就业的实际影响非常有限。

新指标:观察到的暴露度(Observed Exposure)

这项研究最有价值的贡献是提出了一个新的衡量方式。过去的研究大多只看”理论上 AI 能不能做这个任务”,而 Anthropic 结合了三个维度:O*NET 职业任务数据库、LLM 理论能力评估,以及 Claude 的真实使用数据。

关键区分在于:他们把”自动化用途”和”增强用途”分开计算,前者权重更高。这意味着,如果用户只是用 AI 辅助写邮件(增强),和用 AI 完全替代某个工作流程(自动化),两者对就业的威胁程度是不同的。

理论能力 ≠ 实际覆盖

研究中最让我印象深刻的结论是:AI 的实际覆盖范围远低于理论可能性。换句话说,即使技术上 LLM 可以做某件事,实际用户大规模采用并替代人工的比例仍然很低。

这跟我日常观察一致。身边很多开发者和知识工作者确实在用 AI 工具,但几乎没人因此被裁。更常见的场景是:原来做 3 小时的事情,现在 1 小时搞定,然后多出来的时间做了更多的事。

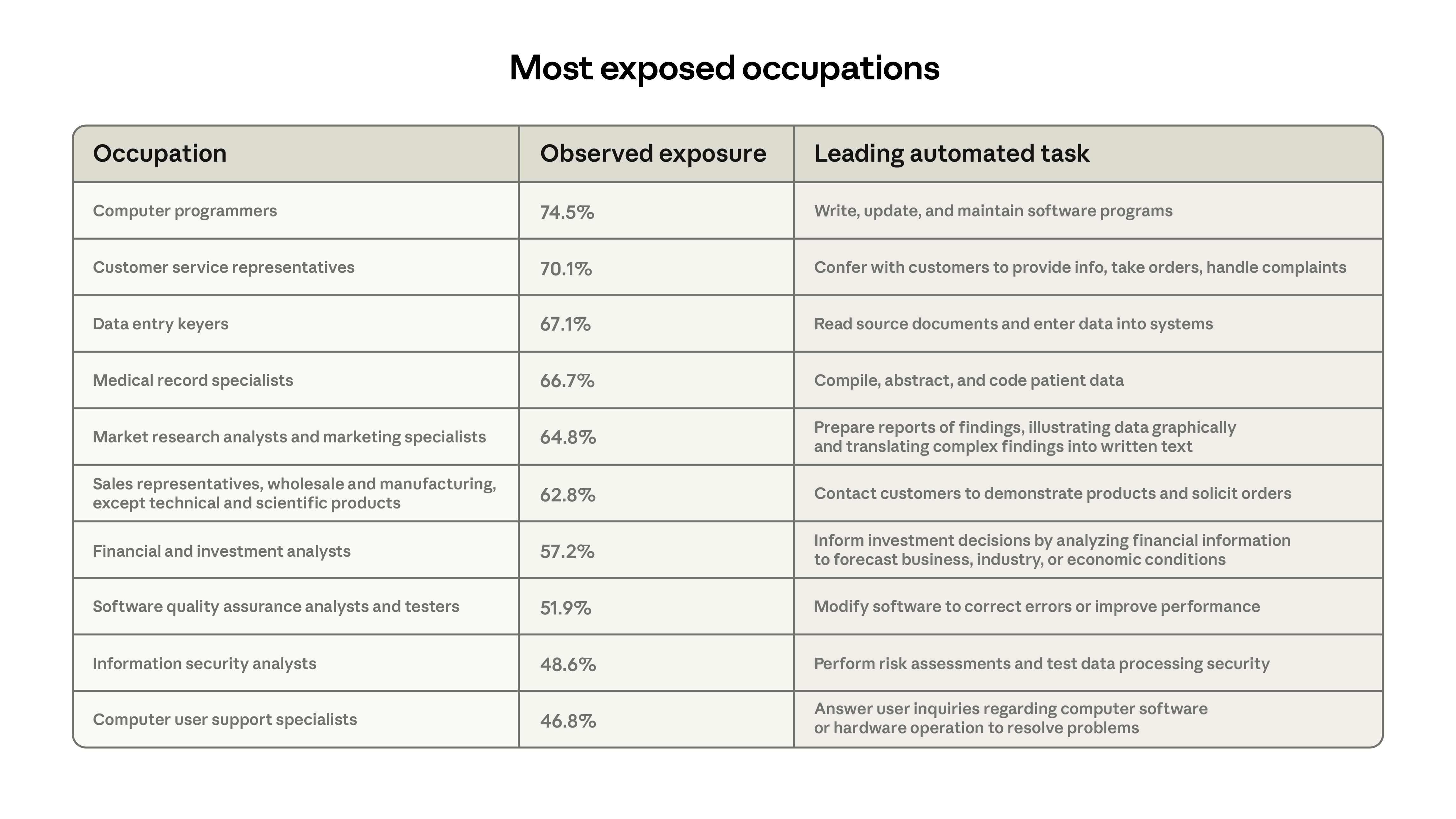

谁最”危险”?

数据显示,AI 暴露度最高的群体是:年龄更大、女性居多、教育程度更高、薪资更高的工作者。这与直觉中”AI 先替代低技能工作”的叙事相反。

不过研究也发现了一个值得警惕的信号:在高暴露度职业中,年轻人的招聘速度在放缓。虽然还不构成大规模失业,但可能预示着入门级岗位正在收窄。

一点个人看法

Anthropic 作为 AI 公司主动做这种研究,我认为是值得肯定的。很多 AI 公司只谈”赋能”不谈”替代”,或者反过来,媒体只渲染恐慌不看数据。这篇论文比较诚实:承认理论上有风险,同时用数据说明目前还没发生大规模影响。

对开发者来说,这里有一个重要的启示:工具的理论能力和实际采用之间存在巨大鸿沟。技术上可行不等于市场上会发生。这也是为什么在选择 AI 工具时,实际上手试用比看评测重要得多。像 OfoxAI(ofox.ai)这样的多模型聚合平台,让你低成本地在 Claude、GPT、Gemini 之间切换对比,自己判断哪个模型真正适合你的工作场景。

与其焦虑”AI 会不会取代我”,不如关注一个更实际的问题:我有没有在用 AI 让自己变得更有效率。答案如果是否定的,那才是真正的风险。

论文链接:Labor market impacts of AI: A new measure and early evidence